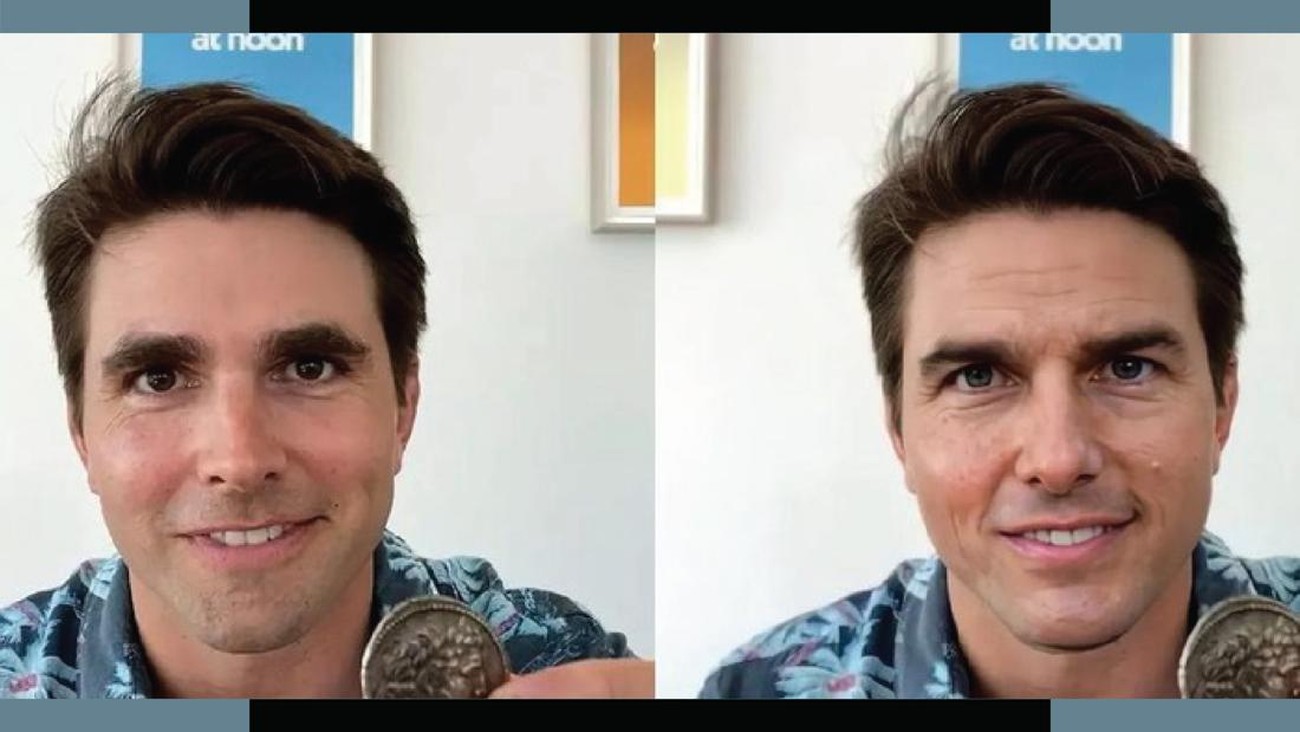

Kalau kamu adalah pengguna TikTok, kamu pasti pernah menemukan video deeptomcruise serangkaian video parodi yang diedit menggunakan wajah Tom Cruise. Ada video Tom Cruise sedang bermain golf, video Tom Cruise sedang bernyanyi, hingga video Tom Cruise sedang potong rambut. Namun, semua video ini bukanlah Tom Cruise sungguhan, melainkan hasil editing menggunakan teknologi artificial intelligence bernama deepfake. Video-video ini dibuat oleh seorang pengguna TikTok bernama Chris Ume bersama dengan aktor Miles Fisher. Chris kemudian menggunakan deepfake untuk mengganti wajah Miles dengan wajah Tom Cruise.

Deepfake merupakan gabungan dari kata deep learning dan fake. Istilah ini muncul di tahun 2017 ketika seorang pengguna Reddit bernama Deepfakes membagikan konten video dewasa di mana wajah pemeran aslinya telah diganti dengan wajah berbagai selebriti Hollywood. Ada dua metode untuk membuat deepfake, pertama yaitu menggunakan algoritma AI bernama encoder. Pertama-tama, kita harus mengumpulkan ribuan foto dari dua orang yang berbeda. Lalu, encoder akan memprosesnya untuk menemukan kemiripan dan memancarkan wajah A ke wajah B di video lain. Selain encoder, deepfake juga bisa dibuat menggunakan Generative Adversarial Network atau GAN yang menggunakan komponen generator dan discriminator untuk menghasilkan data sintetis.

Deepfake/ Foto: Detik.com Deepfake/ Foto: Detik.com |

Deepfake tidak bisa dibuat di komputer biasa. Tetapi dengan berkembangnya teknologi, sekarang siapa pun bisa membuat deepfake dengan menggunakan aplikasi face swap. Melalui aplikasi ini, kita bisa mengubah wajah kita menyerupai wajah teman atau bahkan wajah selebriti yang kita idolakan. Deepfake juga bisa digunakan untuk tujuan komersial, seperti film atau video musik. Misalnya, di video musik terbaru Kendrick Lamar The Heart Part 5, kita bisa melihat wajah Kendrick berganti-ganti menjadi Kanye West, O.J. Simpson, dan Will Smith.

Di permukaan, deepfake terlihat seperti teknologi yang digunakan sebatas untuk hiburan. Tapi pada kenyataannya, maraknya penggunaan deepfake menyimpan risiko tersendiri. Pada tahun 2019, perusahaan artificial intelligence Deeptrace menemukan bahwa 96 persen deepfake merupakan konten porno. Dan sebagian besar di antaranya menggunakan wajah selebriti perempuan. Di Indonesia, selebriti Nagita Slavina juga pernah menjadi korban dari video deepfake. Ke depannya, mungkin bukan hanya selebriti saja yang wajahnya digunakan untuk deepfake, wajah kita pun juga bisa digunakan oleh pihak-pihak tak bertanggung jawab. Skenario terburuknya, deepfake bisa digunakan sebagai alat untuk melakukan revenge porn.

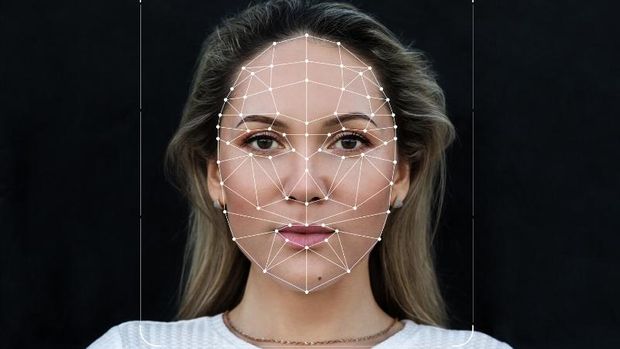

Ilustrasi deepfake/ Foto: Common Sense Ilustrasi deepfake/ Foto: Common Sense |

Tak hanya itu, deepfake juga bisa dimanfaatkan untuk memalsukan identitas dan menyebarkan misinformasi. Bahkan, beberapa peneliti memiliki kekhawatiran adanya gelombang propaganda deepfake. Sebab, deepfake juga dimanfaatkan untuk membuat konten palsu yang memuat wajah politikus. Salah satu contohnya, di media sosial sempat beredar video deepfake Presiden Zelensky yang menyatakan bahwa Ukraina menyerah kepada Rusia dan meminta warganya untuk menurunkan senjata. Hal ini menunjukkan bahwa deepfake bisa memperparah penyebaran fake news dan mempengaruhi opini publik.

Dengan besarnya risiko dari penggunaan deepfake, sayangnya hingga kini belum ada teknologi yang bisa membantu kita dengan mudah mendeteksi deepfake. Namun, ada beberapa cara untuk mengenali deepfake, yaitu dengan mengetahui beberapa karakteristiknya. Biasanya, konten deepfake akan memiliki glitch yang bisa diamati. Glitch tersebut bisa terlihat dari gerakan mata yang tidak wajar, ekspresi wajah yang tidak wajar atau canggung, postur tubuh yang canggung, pewarnaan yang tidak alami, gambar yang blur, dan audio yang tidak konsisten.

Maraknya penggunaan deepfake harus diwaspadai. Dengan teknologi ini, kita akan semakin sulit untuk membedakan mana yang konten asli dan mana yang buatan. Oleh sebab itu, kita juga harus bijak dalam membagikan konten dan mencari tahu terlebih dahulu kebenarannya.

(DIR)